L'intelligenza artificiale continua a evolversi, e con essa, le possibilità per le aziende di personalizzare e ottimizzare gli strumenti a loro disposizione. La recente introduzione del fine-tuning per GPT-4o segna un passo significativo in questa direzione, offrendo alle imprese la possibilità di affinare il modello per rispondere a esigenze specifiche e migliorare le prestazioni delle proprie applicazioni.

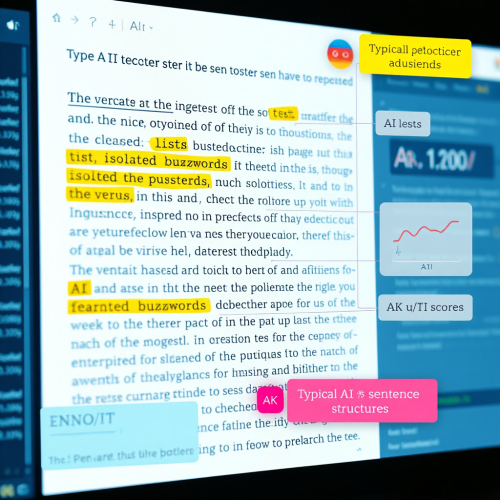

Fine-tuning significa molto più che un semplice miglioramento delle capacità di GPT-4o. Questo processo permette ai modelli di apprendere da dataset personalizzati, riflettendo il linguaggio, le strutture e le preferenze di una specifica azienda. Con pochi esempi ben selezionati, le aziende possono trasformare GPT-4o in uno strumento altamente specializzato, adatto a compiti complessi che spaziano dalla programmazione al content creation.

Le prime testimonianze di successo non tardano ad arrivare. Cosine, ad esempio, ha affinato GPT-4o per il suo assistente software di ingegneria, Genie, raggiungendo risultati sorprendenti. Grazie a un fine-tuning mirato, Genie è in grado di identificare e risolvere bug, costruire nuove funzionalità e refattorizzare codice con una precisione mai vista prima. Cosine ha raggiunto un punteggio SOTA (State of the Art) del 43,8% sul benchmark SWE-bench Verified, stabilendo un nuovo standard nel settore.

Ma non è solo il settore della programmazione a beneficiare di queste innovazioni. Distyl, un partner di soluzioni AI per le aziende Fortune 500, ha ottenuto il primo posto nel benchmark BIRD-SQL, grazie alla capacità del modello fine-tuned di riformulare query, classificare intenti e generare SQL con un'accuratezza del 71,83%. Questi risultati evidenziano come il fine-tuning non sia solo un miglioramento incrementale, ma una rivoluzione nella personalizzazione dell'AI.

Un altro aspetto cruciale è la sicurezza e la privacy dei dati. I modelli personalizzati rimangono sotto il pieno controllo delle aziende, garantendo che i dati utilizzati non vengano condivisi o utilizzati per addestrare altri modelli. Questo è particolarmente importante in un'epoca in cui la gestione etica e sicura dei dati è una priorità assoluta.

La possibilità di fare fine-tuning su GPT-4o è ora disponibile per tutti gli sviluppatori, a partire da un costo di 25 dollari per milione di token di addestramento. Questo rende l'adozione di modelli personalizzati accessibile anche per le piccole e medie imprese, ampliando la gamma di applicazioni che possono beneficiare di questa tecnologia avanzata.

Con il lancio del fine-tuning per GPT-4o, il futuro dell'AI si presenta sempre più adattabile e specifico, permettendo alle aziende di sfruttare appieno le potenzialità dell'intelligenza artificiale. L'invito a esplorare queste nuove frontiere è aperto, con la consapevolezza che i risultati ottenuti finora rappresentano solo l'inizio di un cammino che cambierà radicalmente il modo in cui utilizziamo la tecnologia.

Riepilogo dettagliato delle informazioni, con riferimenti ai dati e alle fonti menzionate:

Dati Principali

Fine-tuning di GPT-4o:

- Disponibilità: Il fine-tuning per GPT-4o è disponibile per tutti gli sviluppatori sui livelli di utilizzo a pagamento.

- Costo: 25 dollari per milione di token di addestramento; 3,75 dollari per milione di token input e 15 dollari per milione di token output.

- Token gratuiti: Fino al 23 settembre, sono offerti 1 milione di token di addestramento gratuiti al giorno per ogni organizzazione.

GPT-4o Mini:

- Disponibilità: Anch'esso disponibile per tutti gli sviluppatori sui livelli di utilizzo a pagamento.

- Token gratuiti: Fino al 23 settembre, sono offerti 2 milioni di token di addestramento gratuiti al giorno.

Casi studio:

- Cosine:

- Prodotto: Genie, un assistente AI per l'ingegneria del software.

- Risultati: Ha raggiunto un punteggio SOTA (State of the Art) di 43,8% nel benchmark SWE-bench Verified e 30,08% in SWE-bench Full, migliorando il precedente record di 19,27%.

- Distyl:

- Risultati: Prima posizione nel BIRD-SQL benchmark, con un'accuratezza di esecuzione del 71,83%.

- Cosine:

Fonti Menzionate

- GPT-4o fine-tuning: Lancio annunciato per l'agosto 2024, con una disponibilità immediata per tutti gli sviluppatori paganti.

- Cosine e Genie: Utilizzo di GPT-4o per raggiungere prestazioni all'avanguardia nel benchmark SWE-bench, specificamente per l'ingegneria del software.

- Distyl: Successo nel benchmark BIRD-SQL, con GPT-4o personalizzato.

Riferimenti a Strumenti e Benchmark

- SWE-bench: Un benchmark che valuta le capacità dei modelli AI nel contesto dell'ingegneria del software, specificamente per la risoluzione di bug, costruzione di funzionalità, e refactoring del codice.

- BIRD-SQL: Benchmark leader per la generazione di SQL da testi in linguaggio naturale, dove GPT-4o ha eccelso grazie alla personalizzazione attraverso il fine-tuning.

Sicurezza e Privacy

- Il fine-tuning di GPT-4o garantisce che i dati delle aziende rimangano sotto il loro completo controllo. Questo significa che né i dati né i modelli personalizzati saranno condivisi o utilizzati per addestrare altri modelli, assicurando la riservatezza e la protezione delle informazioni aziendali.

Glossario

- Fine-tuning: Processo di ottimizzazione di un modello AI per specifici compiti tramite l'addestramento su dataset personalizzati.

- GPT-4o: Versione avanzata del modello linguistico GPT-4, progettata per applicazioni aziendali.

- SOTA (State of the Art): Termine che indica le prestazioni più elevate raggiunte in un determinato benchmark.

- SWE-bench: Benchmark specifico per testare le capacità di modelli AI nel contesto dell'ingegneria del software.

- BIRD-SQL: Benchmark leader nel settore per la generazione di SQL da testi in linguaggio naturale.

- Token: Unità base di testo elaborata dal modello, che può rappresentare un carattere, una parola o un'intera frase.